Was lauert hinter dem Uncanny Valley? Perfekte Fälschungen!

Vorwort – Eine lauernde Gefahr

Genau solch ein fundamentaler Wandel steht uns in naher Zukunft auch bevor. Ich fürchte nur, dass die Konsequenzen weit negativer sind. Aber lasst mich das Thema mal ausführen, beziehungsweise vorerst nochmal auf den Titel zurückkommen.

Was ist das Uncanny Valley?

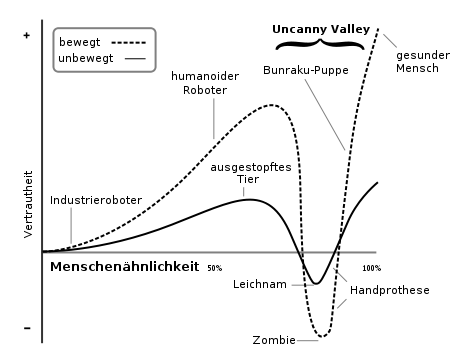

Uncanny Valley ist die Bezeichnung für die Akzeptanzlücke für einen paradox erscheinenden Effekt, der bezüglich der Akzeptanz von künstlichen Figuren auf Zuschauer auftritt. Ursprünglich wurde dieser Effekt als erstes von Masahiro Mori als „Phänomen des unheimlichen Tals“ beschrieben. [1] Die Akzeptanz von künstlichen Figuren steigt nämlich nicht linear mit dem Anthropomorphismus (der Menschenähnlichkeit) , sondern in einer gewissen Spanne stellt man diesbezüglich einen sehr großen Einbruch da. Folgende Grafik verdeutlicht das sehr schön:

Verdeutlichung des Uncanny Valley Phänomens - Quelle: LINK

Die vertikale Achse definiert die Vertrautheit für die Zuschauer, die horizontale Achse definiert die Menschenähnlichkeit. Die Theorie des „Uncanny Valley“ besagt also, dass ab einen gewissen Grad der Menschlichkeit die Akzeptanz total abfällt. Erst wenn die Ähnlichkeit so enorm ist, dass die künstliche Figur sowieso nicht mehr vom Menschen zu unterscheiden ist, steigt die Akzeptanz wieder an.

Erklärungen für das Uncanny Valley

Es gibt verschiedene Erklärungen für dieses Phänomen, wobei keine als ausreichende wissenschaftliche Erklärung dient. [2]1. Medienpsychologische Erklärung: Figuren, die eindeutig auf den ersten Blick maschinell wirken, wird zusätzliches menschliches Verhalten bzw. menschliche Eigenschaften gutgeschrieben. Versucht jedoch eine Figur offensichtlich menschlich zu wirken, wird ihr jede Art von mechanischen Verhalten als Fehler angemerkt.

2. Psychologische Erklärung: Roboter die probieren sich menschlich zu präsentieren werden unterbewusst vom Beobachter mit dem selben Maßstäben gemessen wie Menschen. Somit werden unnatürliche Eigenschaften sofort negativ war genommen.

3. Neurowissenschaftliche Erklärung: Mit Untersuchungen durch Magnetresonanztomographie konnte man Hinweise finden, dass möglicherweise die Abweichungen der intern gebildeten Vorhersage das Phänomen verursachen könnte.

Das ist auch einer der Gründe warum Animationsfirmen wie Disney oder Pixar viel mehr in die Richtung gehen Charaktere zwar realistisch wirken zu lassen, jedoch nicht menschlich. Sie werden, sowohl bewusst als auch unterbewusst, mehr akzeptiert.

Wir haben das Uncanny Valley schon durchquert!

Viele Experten wie CGI-Artists, Engine-Programmier oder GPU-Hersteller sehen das Uncanny Valley schon als durchquert an. Die Kombination zwischen immer fähigeren Engines und Animationssoftware-Produkten kombiniert mit dem jährlichen Anstieg an Compute-Power, vor allem im Grafikkartenbereich, hat dafür gesorgt das fotorealistische CGI als machbar angesehen wird. Solange man genug Ressourcen hat, die man investieren kann. Ein gutes Video welches exakt diesen Umstand erklärt findet ihr hier:KI trifft CGI - Wo liegt die Gefahr?

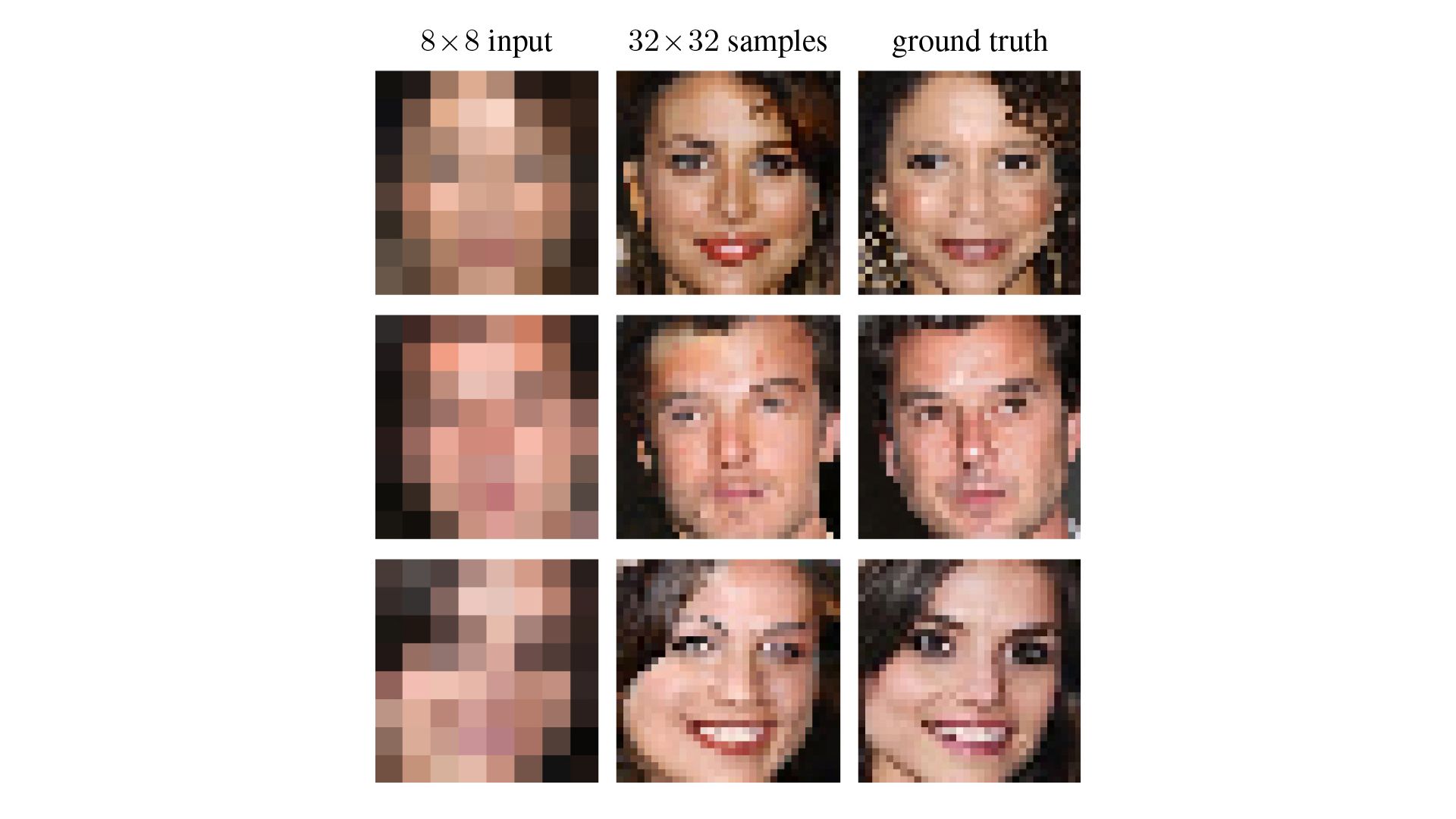

Es geht um die Technologie die momentan in aller Munde ist: Künstliche Intelligenz. Auf Bilder/Videos bezogen war es anfänglich nur eine Mustererkennung, nun sind wir dank neuronalen Netzwerken schon viel weiter. Softwareprodukte wie der aktuelle Photoshop können dank künstlicher Intelligenz menschliche Motive schon automatisch freistellen[2]. Ein Produkt von Google kann stark verpixelte Portraits wieder ein erkennbares Gesicht geben.[3]

Gefährlich wird es ab dem Moment, in dem die Künstliche Intelligenz mit der Kraft moderner Engines kombiniert wird und die reine Täuschung des Zuschauers als Ziel deklariert wird. Es wird etwas geschaffen, was selbst für Experten nicht mehr als künstliches Produkt erkannt werden kann. Genau dieser Trend kommt gerade auf uns zu.

Deep Fakes - Alles wird zur Fälschung

So unerträglich schrecklich gefälschte Pornos für die abbildenden Personen selbst sein müssen, können Deep Fakes noch viel schlimmere und größere Auswirkungen haben. Ich zeige hier kurz mal ein Beispiel welches mit dem 44. Präsidenten der Vereinigten Staaten, Barack Obama, erstellt worden ist:

For example, Jordan Peele's production company Monkeypaw Productions put the Obama video together using FakeApp and Adobe's popular After Effects program for graphics editing. BuzzFeed reports it took 56 hours of automatic processing, overseen by a video effects profesional, to get the video right.[5]Jedoch ist es bei der enormen Entwicklungsgeschwindigkeit in den Feldern Rechenleistung und neuronalen Netzwerken nur eine Frage der Zeit, bis es auf Knopfdruck klappt.

Bei Sprachsynthese ist man schon länger sehr weit vorgeschritten. Adobe hat solch eine Funktion seit längeren in sein Audiosoftwareprodukt integriert bei der normalen Texteingabe in die passende Stimme umgewandelt wird:

Unendlich gefährlich - Möglicherweise weltverändernd

Die entsprechenden Beispiele sind hierbei natürlich endlos. Man denke sich nur Hacker würden ein TV-Signal eines Senders kurzschließen und eine Kriegserklärung des Präsidenten gegenüber eines Nachtbarlandes erläutern. Oder man könnte politische Gegner in kürzester Zeit völlig bloßstellen. Dies wären Fake-News auf einem Niveau, welches wir uns momentan noch gar nicht vorstellen können.“The prospect of any Internet rando being able to swap anyone’s face into porn is incredibly creepy. But my first thought is that we have not even scratched the surface of how bad ‘fake news’ is going to get.” - Julian Sanchez[7]Die Technologie ist vorhanden, und wächst unglaublich schnell. Wir müssen uns somit als Gesellschaft Gegenmaßnahmen überlegen.

Können wir dagegen etwas tun?

Selbst normale Fake-News Berichte sind momentan schon ein Problem. Man braucht sich nur die ganze Berichterstattung über den letzten Präsidentschaftswahlkampf ansehen. Hierbei handelt es sich jedoch meist um Nachrichten die noch relativ leicht, zumindest von Experten, als Fälschung enttarnt werden können. Hier kann man also mit Medientethik und früher Bildung über die Verwendung/Konsum von Medien stark entgegenwirken. Zusätzlich ist es oft leicht möglich mit dem verlinken auf tatsächliche Fakten/Beweise/mehrfacher (richtiger) Berichterstattung die im Umlauf gebrachten Fake-News zu entlarven.Video-Aufnahmen gelten bislang als wichtige Beweise, um Sachverhalte zu klären. Das könnte bald vorbei sein, denn die Manipulation von Bewegtbildern ist technisch quasi für jeden möglich. Öffentlichkeit und vor allem Medienmacher müssen künftig also noch viel genauer hinschauen, welche Videos echt sind und welche manipuliert.[8]

Bei perfekten selbst erschaffenen Fälschungen ist es natürlich völlig unmöglich. Selbst Experten können dies nicht. Wird etwas in eine gewöhnliche Videoaufnahme verpackt ist es auch völlig unschlüssig ob eine Aufnahme von einem menschlichen Team kreiert worden ist, oder nur ein neuronales Netzwerk dahintersteckt. Alles wird fälschbar.

Bietet die Blockchain eine Lösung?

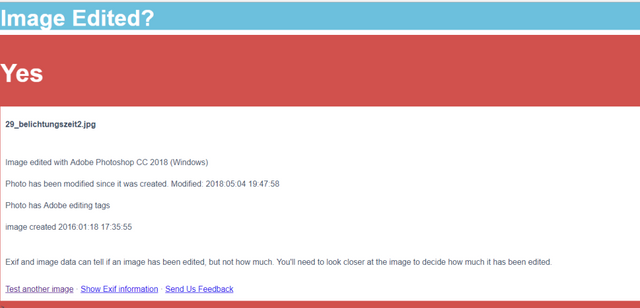

Das ist eine Frage die momentan keine Lösung kennt. Für Einzelbilder gibt es ja schon passende Algorithmen, die sich den Bildaufbau bzw. die Metadaten von Bildern ansehen und entsprechend sagen ob solch ein Bild gefälscht wurde oder nicht.

Bei Videos sieht das, schon alleine aufgrund der Datenmenge und der notwendigen Rechenleistung ganz anders aus. Auch bringt das Dasein solcher Softwareprodukte gar nichts, wenn sie nicht verwendet werden. Diese müssten gesetzlich in jegliche Plattformen wie Facebook, Youtube und Co. integriert werden. Selbstverständlich ist jegliche Softwarekontrolle wiederum übergehbar, wenn man möchte.

Die Blockchain bietet mit dem Grundsatz, dass etwas aus der Kette nicht löschbar ist diesbezüglich eine interessante Eigenschaft. Somit wäre es theoretisch immer möglich den ersten Upload/Version eines Videos zu bestimmen und somit spätere mögliche Fälschungen zu entlarven bzw. die richtige Version zu deklarieren. Hier ist wiederum fraglich wie dies in den Alltag beziehungsweise in Mainstream-Medien integriert werden kann.

Ich finde es jedenfalls sehr komisch das in keiner der vielen Berichten, die ich nun bezüglich Fake-News recherchiert habe das Wort Blockchain auch nur einmal gefallen ist. Deswegen seid ihr nun dran.

Mich würde eure Meinung/Vorschläge interessieren

Zwar kenne ich mich selbst in der Videotechnik und den verwandten Themengebieten sehr gut aus, jedoch bin ich bei der Blockchain noch ein Anfänger und fühle mich nicht fähig hier ultimative Aussagen über die Möglichkeiten zu nennen. Hier auf Steemit gibt es zum Glück unzählige Experten bezüglich dieses Thema, dementsprechend würde ich mich unglaublich freuen von euch qualitativen Input zu bekommen. Vor allem in der deutschsprachigen Community sind wir da gefühlt sehr gesegnet mit Fachwissen.Ich könnte mir zum Beispiel eine digitale Signatur vorstellen die Videodateien mit einer Kamera bei der Aufnahme verknüpft und klar als real gefilmtes Material deklariert. Diese Speicherung würde wiederum in der Blockchain erfolgen. Jedoch weiß ich nicht ob ich diese Möglichkeit zu Ende denken kann.

Fazit

Das Uncanny Valley wird sehr bald komplett hinter uns liegen, egal ob in der Robotik, oder in der Welt der von Computer erstellten Bilder und Videos. Mit einem neuen technologischen Kapitel dieses Ausmaßes wird es auch notwendig sein neue Regeln und Vorgänge zu definieren um nicht die Kontrolle zu verlieren. Bei der Robotik und im allgemeinen Bereich der künstlichen Intelligenz entsteht langsam ein Diskurs darüber, auch wenn dieser meiner Meinung nach immer noch viel zu schwach ist. Bezüglich der bevorstehenden Revolution der Medien gibt es dies jedoch noch nicht. Die Zeit bleibt jedoch, wie auch sonst nirgends, auch in diesen Bereich nicht stehen. Lasst uns bitte nicht eine schlimme Konsequenz benötigen, bis wir hier Regeln und Maßnahmen definieren. Es ist nicht so als wäre es nicht vorhersehbar.Ich hoffe euch hat dieser Bericht meinerseits gefallen und euch eventuell selbst ein wenig zum Nachdenken angeregt. Wie auch sonst würde ich mich sehr auf einen Diskurs zu dem Thema freuen. Eventuell wird nämlich meine Masterarbeit stark in dieser Richtung gehen, somit bin ich über jeglichen Input sehr glücklich.

Quellen:

[1] https://link.springer.com/chapter/10.1007/978-3-642-40744-4_35

[2] https://de.wikipedia.org/wiki/Uncanny_Valley

[3] https://arstechnica.com/information-technology/2017/02/google-brain-super-resolution-zoom-enhance/

[4] https://de.wikipedia.org/wiki/Sprachsynthese

[5] https://www.tomsguide.com/us/deepfake-faq-fake-video-fakeapp,news-27003.html

[6] https://www.rnz.de/wirtschaft/wirtschaft-magazin_artikel,-Wirtschaftsmagazin-Heidelberger-Software-steuert-Zugdurchsagen-in-Oesterreich-_arid,87181.html

[7] https://www.lawfareblog.com/deep-fakes-looming-crisis-national-security-democracy-and-privacy

[8] http://faktenfinder.tagesschau.de/hintergrund/deep-fakes-101.html

Top Post !

Vielen lieben Dank!

WOW! Ein wirklich sehr interessantes Thema wunderbar aufbereitet. Absolut lesenswert, vielen Dank dafür :)

Ich bin zwar Informatiker, aber kein Profi in diesem Bereich. Was ich mir dennoch gut vorstellen kann ist, dass man das Original eines Videos immer von einer Kopie unterscheiden kann - sofern es mit Dingen wie Hashing, Signaturen, Teilverschlüsselungen etc. "gebranntmarkt" wird.

Solche Verfahren würden allerdings im Nachhinein geschehen, was auch nicht ausschließt, dass zuvor weitere Kopien erstellt wurden. Interessanter wäre eine "Verschlüsselung" während der Aufnahme.

Man stelle sich vor, dass man als Benutzer einer Kamera in irgendeiner Weise eindeutig identifizierbar ist. Das muss nicht Name, Anschrift, Schuhgröße sein. Es können auch einmalig generierte und nicht wiederherstellbare Signaturen sein (ähnlich wie es hier mit dem Passwort geschieht).

Damit wäre sichergestellt, dass das Rohmaterial zunächst für JEDEN nutzlos ist, der sich nicht authentifizieren kann. Unmittelbar danach können durch den Besitzer weitere Maßnahmen durchgeführt werden.

Plattformen, die Daten entgegen nehmen, können ebenfalls ihre Brandmarken setzen, sodass sie "wissen" von wem ein bestimmtes Datum ursprünglich kam oder es zumindest von einer Kopie unterscheiden können.

Je mehr man drüber nachdenkt und schreibt, desto mehr Ideen und Verwerfungen kommen. Daher höre ich mal auf :)

Vielen Dank noch mal

Dafür brauchst du dich ja nicht bedanken, den Artikel habe ich ja einfach verfasst um das Thema eventuell in Köpfe zu bekommen die sich zuvor damit noch nicht beschäftigt hatten.

Solche fachkundige Kommentare wie deine sind natürlich dann eine große Freude meinerseits. Dein Vorschlag klingt sehr spannend:

Das könnte ich mir tatsächlich genauso vorstellen. Wie würdest du die Speicherung/Sicherung dieser Signaturen abwickeln?

Super post. Die technischen Möglichkeiten im Bezug auf das Fälschen von Videos sind tatsächlich beängstigend. Ich finde deine Idee, die Blockchain als Lösungsansatz zu verfolgen, aber hochinteressant. Wie würdest du dir das konkret vorstellen? Die chain müsste ja gigantische Datenmengen stemmen können, und man müsste einen Algorithmus integrieren, der Fälschungen identifiziert? Geht so was?

Wie gesagt, ich bin diesbezüglich nicht der Experte. Ich würde das eher als Signatur verstehen. Also quasi das man bei Videos wo man unbedingt will dass diese später als eindeutig identifizierbar sind einen Hashcode generiert der durch einen Algorithmus bestimmt wird welcher zuvor das Bild analysiert. Bei diesen Prozess fällt also die Rechenpower an. Dieser Hashcode wird dann in der Blockchain gespeichert und ist somit für ewig erhalten und deklariert weiters den ersten Upload dieses Material. Taucht nun später eine andere Version dieses Videos auf kann wiederum dieser Code berechnet werden und gegengeprüft werden. Wurden zuvor aber Pixelwerte verändert bzw. das Video umgeschnitten ist natürlich der Wert nicht ident.

Ich bin mir sicher das ich hier irgendwelche Wissenslücken meinerseits auftun, aber im Grunde wäre das meine Idee. Ich würde mir sehr freuen wenn mir ein Experte darauf eine Antwort geben könnte.

ich finde das klingt nach einem extrem geilen Projekt! schade dass ich kein Informatik-Guru bin.

Wow - ein super interessanter Beitrag !

Vielen lieben Dank für dein Lob :)

Ein wirklich ausgezeichneter Beitrag, der verdeutlicht was auf uns zukommt. Ein Grund mehr sich von gewissen Medien fern zu halten.

Vielen Dank und Grüße vom @faltermann 🐛

Echt ein interessantes Thema. Ich bin mir absolut sicher das wir uns bald stark mit Fälschungen Juristisch beschäftigen müssen. Ob die Blockchain die Lösung ist? Ich weiß es nicht. Auf jeden Fall können wir es versuchen. Aber ich glaube es könnte sicherlich noch andere Lösungen geben. Derzeitig fällt mir aber keine ein ^^'

Danke, ich finde das Thema auch immens spannend. Sieh dir mal meine Antwort auf Scos Kommentar an, so würde ich mir das zirka vorstellen. Keine Ahnung ob das recht Sinn ergibt. Jedenfalls bin ich froh das es diesbezüglich sicher intelligentere Menschen gibt die sich damit hoffentlich rechtzeitig beschäftigen.

Du machst interessante und spannende Dinge. Sehr gut!!!

WOW, das nenn ich mal einen genialen Post! Einfach nur WOW, bin gerade spachlos😉 👌

Vielen lieben Dank! Ich glaub das ist das größte Lob das ich jemals auf Steemit bekommen habe.

Die Auswirkungen durch das durchqueren des uncanny valley kann man sich glaube ich nur im Ansatz ausmalen..

Kleiner Tippfehler?

Ich denke es soll ersetzt heißen.

Mit deiner Einschätzung liegst du absolut richtig! Auch vielen Dank für deinen Hinweis auf meinen peinlichen Fehler :)

Sehr spannendes Thema und wirklich gut und leicht verständlich aufgearbeitet!

Mir war es nicht bewusst, wie weit die Technik schon ist und wie nahe wir der endgültigen Überwindung des Uncanny Valleys stehen. Es ist erschreckend, was inzwischen schon alles möglich ist, und wohin sich das ganze entwickeln wird. Ich bin sehr gespannt, was sich diesbezüglich gesellschaftlich, kulturell und globalpolitisch alles ändern wird.

PS: Ich glaube bei der Verlinkung des "GigFake-Reddits" ist dir ein Fehler unterlaufen - beim Draufklicken kommt man nicht auf die Seite.

Vielen lieben Dank für deinen ausführlichen Kommentar, dein Lob und vor allem auch deinen Resteem! Keine sorge, ich selbst war geschockt wie weit fortgeschritten wir da schon sind, normale Bürger haben diesbezüglich ja noch gar keine Ahnung was da auf uns als Gesellschaft zu kommt.

Vielen Dank für den Hinweis, die Anführungszeichen waren nicht richtig. Jetzt geht der Link wieder :)

Dieser Post war mein erster Resteem überhaupt! :D

Aber er hat mich so fasziniert, das musste ich dir einfach gönnen :)

(Ich hoffe es hat auch was gebracht?)